La evolución de la tecnología deepfake, cada vez más avanzada y asequible, obliga a las empresas a buscar herramientas más eficaces para hacer frente a esta creciente amenaza.

Sorprendentemente, la parte más difícil para los estafadores que utilizan deepfakes para eludir la verificación de identidad (IDV) en línea no radica en generarlos, sino en presentarlos a dichos sistemas. ¿Significa esto que las empresas pueden confiar en herramientas de IDV bien establecidas para la detección de deepfakes?

En esta entrada de blog, exploraremos las vulnerabilidades de los sistemas de IDV a los que se dirigen los deepfakes, y destacaremos las estrategias de detección de deepfakes para prevenir eficazmente estos ataques.

Cómo los deepfakes pueden aprovecharse de los puntos débiles de los sistemas IDV

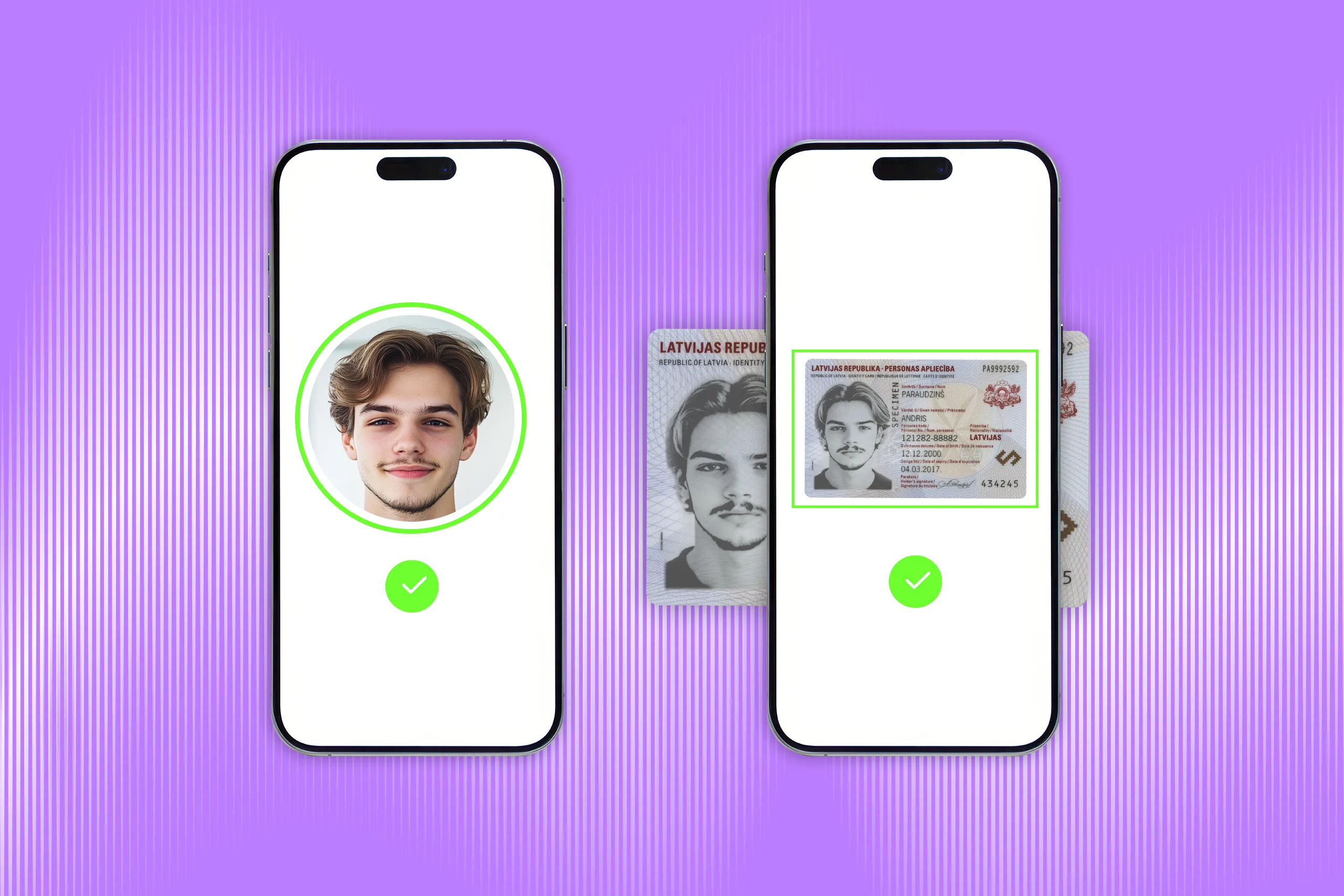

El proceso de verificación de identidad en línea, en el que se suele presentar el selfie de un usuario, puede simplificarse en tres pasos clave: captura de datos, análisis y evaluación, que dan lugar a una decisión de "verificado" o "no verificado".

Dependiendo del escenario—ya sea la identificación de un nuevo usuario o la autenticación de uno que regresa—, la fase de análisis puede implicar la comparación del identificador presentado con una base de datos de individuos conocidos o la realización de comprobaciones de autenticidad específicas, como la verificación del selfie con el retrato del documento de identidad del usuario.

En todos los casos, los estafadores intentan aprovechar los puntos débiles de los sistemas de IDV. Esto se aplica tanto a las herramientas "clásicas", como las máscaras de silicona o los maniquíes, como a las técnicas modernas, como los deepfakes. Es importante que los defensores también conozcan estos puntos débiles.

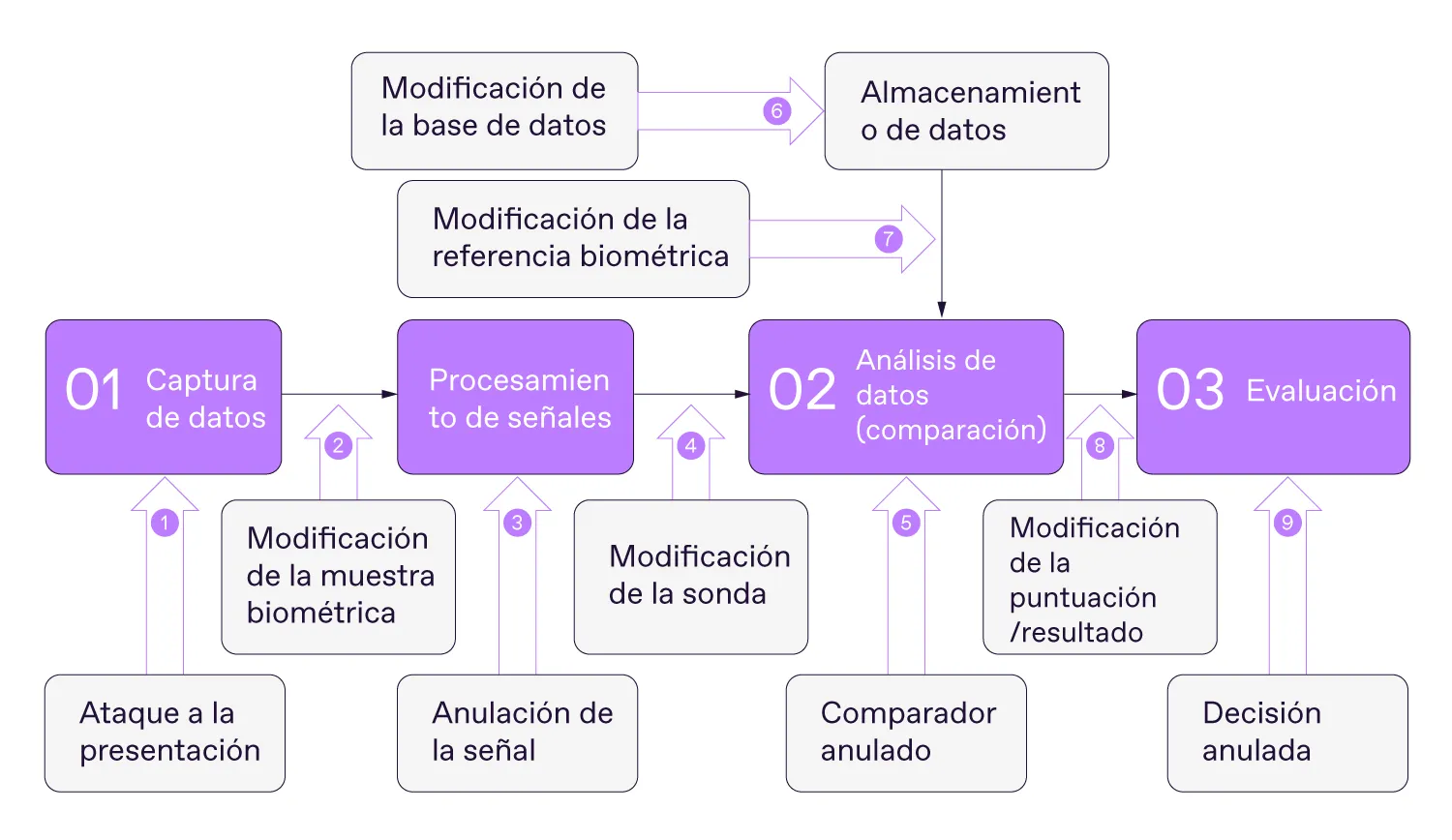

La norma ISO/IEC 30107 sobre detección de ataques a la presentación biométrica identifica al menos nueve etapas vulnerables en el proceso de verificación de selfies en las que podrían producirse ataques. Combinando estos hallazgos con las etapas clave de verificación, llegamos al siguiente mapa de puntos potenciales de ataque:

Según la norma ISO/IEC 30107, existen al menos nueve puntos vulnerables en los sistemas biométricos a los que pueden dirigirse los estafadores.

Con esta idea en mente, la pregunta es: ¿dónde se pueden explotar las deepfakes? En la práctica, hay dos formas principales de utilizar deepfakes al atacar sistemas biométricos:

Presentar imágenes o vídeos falsos al sistema biométrico sin interactuar con todo el proceso (Punto 1 del diagrama).

Inyectar datos deepfake en el flujo (Puntos 2, 4 y 7).

En pocas palabras, los deepfakes pueden utilizarse para ataques de presentación o de inyección. Veamos ahora cuál es la diferencia entre estos métodos.

Cuando se presentan deepfakes al sistema

Los estafadores utilizan tradicionalmente diversas herramientas para los ataques de presentación de rostros, como fotos impresas, recortes de papel, máscaras de varias capas o de silicona, impresiones en 3D, maniquíes y programas de edición de fotos o vídeos como Photoshop. Esto imita a los usuarios legítimos, pero se basa en métodos físicos o híbridos.

Los deepfakes, al ser 100% digitales, se adaptan menos a las formas físicas. El método más eficaz para desplegarlos es como imagen en pantalla o vídeo presentado directamente a la cámara.

Cuando se inyectan deepfakes en el sistema

Las inyecciones son una herramienta más sofisticada en el arsenal de los estafadores. En estos casos, una muestra biométrica se modifica "sobre la marcha".

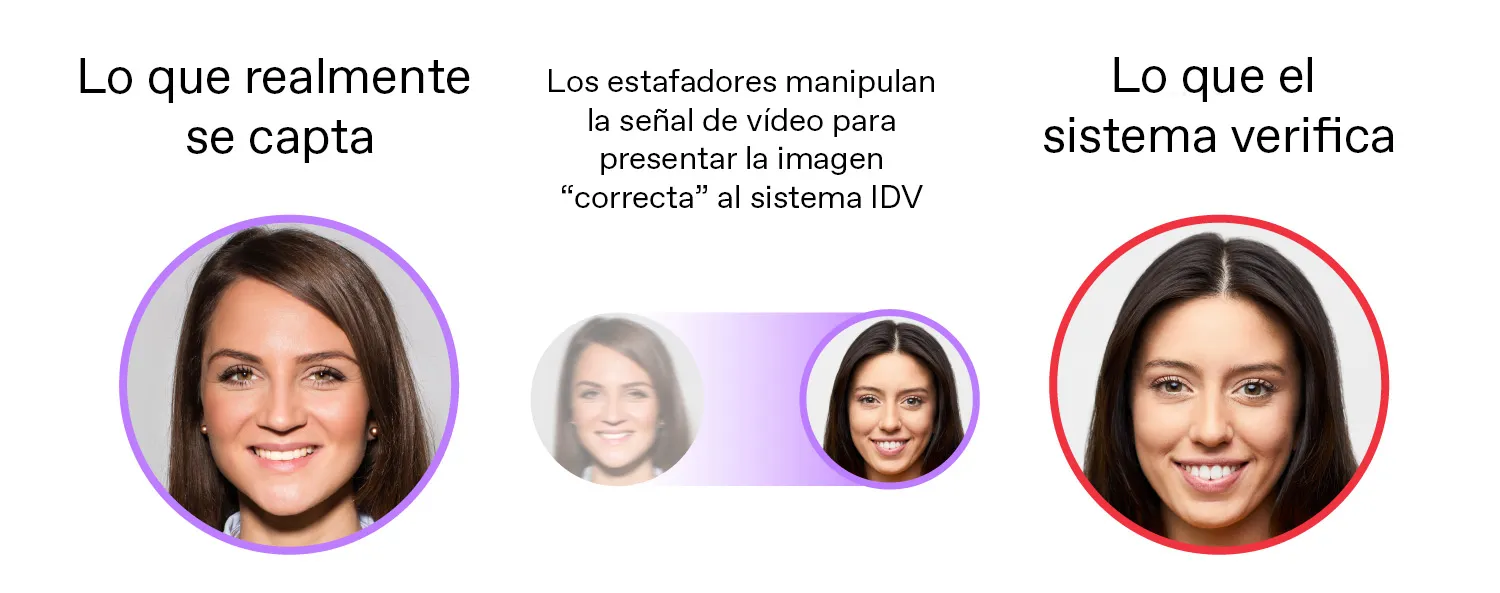

El primer método consiste en modificar la señal de la cámara, de modo que los datos recibidos por el sistema no coincidan con el objeto real presentado.

Para conseguirlo, los estafadores se colocan entre la cámara física y el sistema de verificación biométrica. Mientras que la cámara capta la escena real, el software que la controla puede ser manipulado, sobre todo cuando la imagen se carga a través de una API.

En un ataque de modificación de señal, los estafadores engañan al software de verificación biométrica para que vea una imagen inyectada en lugar de la real.

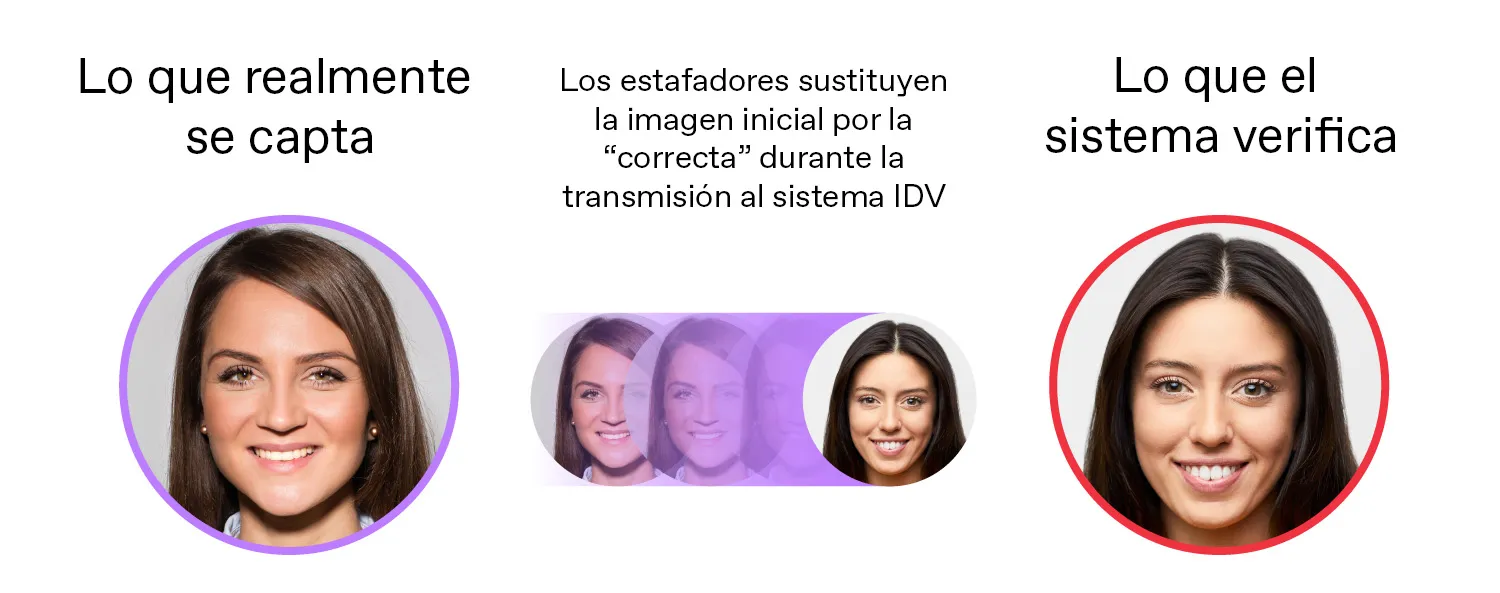

Otra forma de ataque por inyección consiste en alterar una muestra biométrica durante la transmisión. En este caso, los estafadores interceptan los datos cuando se transfieren de la fase de captura a la de análisis, modificándolos en el camino.

La modificación de muestras biométricas permite a los estafadores alterar la imagen presentada antes de que sea analizada por el software.

En consecuencia, aunque los deepfakes son cada vez más avanzados y dañinos, los métodos para explotarlos con el fin de eludir los sistemas IDV permanecen inalterados. Tanto los ataques de presentación como los de inyección se basan en los mismos mecanismos, incluso con la aparición de medios generados por IA.

¿Significa esto que las empresas ya disponen de las herramientas necesarias para afrontar el reto de la detección de deepfakes?

Reciba publicaciones como esta en su bandeja de entrada con el resumen quincenal del blog de Regula

Los componentes clave de un sistema de detección de deepfakes

Actualmente, muchas empresas confían en un marco de IDV que combina la verificación de documentos de identidad con comprobaciones biométricas. Según la encuesta de Regula, el 84 % de las empresas de todo el mundo utilizan la autenticación multifactor y la verificación selfie para mitigar los riesgos relacionados con los deepfakes.

Dado que las deepfakes se presentan a menudo como medios en pantalla, las funciones avanzadas de muchas soluciones de IDV, incluido Regula Face SDK, pueden detectar y rechazar estos intentos. Sin embargo, los ataques más sofisticados, como las inyecciones alimentadas por deepfakes, requieren medidas de seguridad adicionales para ser revelados.

Exploremos qué herramientas pueden utilizar las empresas para combatir estas amenazas.

Prueba de vida

La generación de deepfakes es un proceso que consume muchos recursos, y muchas imágenes o vídeos creados sintéticamente carecen de perfección. Mientras que los selfies estáticos generados por IA pueden parecer impecables, esta ilusión a menudo se desmorona cuando se requiere vídeo en directo. La tecnología deepfake tiene dificultades para reproducir detalles finos como lunares, pecas o barba incipiente, y puede distorsionar accesorios como gafas durante el movimiento. Esto provoca incoherencias en el comportamiento o artefactos poco naturales cuando hay movimiento.

Por este motivo, la prueba de vida es esencial para un sistema robusto de detección de deepfakes. Las actividades aleatorias, como sonreír o girar la cabeza, dificultan la generación de vídeos deepfake convincentes en tiempo real. Las tecnologías de prueba de vida activa y pasiva también son eficaces para identificar imágenes en pantalla.

Verificación móvil

Para contrarrestar los ataques de inyección, los sistemas de verificación biométrica deben garantizar la coherencia de los datos durante la transmisión. Sorprendentemente, el uso de dispositivos móviles en lugar de aplicaciones de escritorio proporciona una mejor protección contra los intentos de inyección si la fuente de la muestra biométrica se encuentra en el perímetro de confianza.

Los sistemas operativos móviles suelen ser más seguros frente a acciones invasivas que los sistemas operativos de PC y los navegadores web, lo que añade una capa de seguridad "por defecto". Sin embargo, una vez más, es fundamental validar la fuente y/o el origen de una imagen o vídeo.

Otra medida eficaz es el uso de soluciones habilitadas por hardware, como los quioscos de autoservicio equipados con cámaras "de confianza", que impiden que los deepfakes se filtren en el sistema.

Transmisión segura de datos

Cuando se trata de verificar la identidad, transferir los identificadores de los usuarios—como información personal confidencial y selfies—a través de canales seguros y cifrados es más que un requisito técnico. También es fundamental verificar la integridad de los datos tras la transmisión.

El cifrado garantiza que los datos estén protegidos de la interceptación y la manipulación, incluidas amenazas sofisticadas como las inyecciones de deepfake u otros intentos de fraude avanzado. Métodos de confianza como el Public Key Infrastructure (PKI), los protocolos a prueba de manipulaciones y las herramientas de validación en tiempo real ayudan a mitigar los riesgos de deepfake, así como las amenazas más "convencionales". Estas medidas se alinean con el uso de funciones hash criptográficas, en las que se generan y verifican huellas dactilares de datos únicas para garantizar la integridad de los datos transferidos.

Tecnología deepfake en la falsificación de documentos de identidad: ¿Cómo abordarla?

Cuando se trata de documentos de identidad, existen muchas menos herramientas generadas por IA para que los estafadores puedan crearlos. Sin embargo, esta tecnología es explotada por servicios de la darknet como OnlyFake, que no pueden ser ignorados por las empresas y los proveedores de IDV.

Las comprobaciones de autenticidad estándar cuando se verifica el diseño del documento y la presencia de elementos de seguridad están diseñadas principalmente para la verificación de la identificación física. Durante los flujos en línea, pueden mejorarse con una comprobación activa de la vitalidad del documento de identidad, exigiendo a los usuarios que inclinen el documento delante de la cámara para demostrar elementos de seguridad dinámicos como hologramas u OVI.

Los documentos de identidad biométricos con chips RFID ofrecen una defensa aún más segura contra las falsificaciones. En regiones en las que los documentos de identidad electrónicos están muy extendidos, las empresas pueden utilizar la verificación "sólo pasaporte biométrico " para defenderse de los DNI alterados o falsos. Este enfoque también mejora la experiencia del cliente, ya que la verificación NFC se realiza en cuestión de segundos.

Así que los deepfakes no son perfectos. ¿Lo serán?

Las fotos y vídeos generados por IA son impresionantes. Aunque no son perfectos, todavía no hemos llegado al punto más alto de esta tecnología. En el horizonte se vislumbran modelos más grandes, multimodales y con nuevas capacidades.

Sin embargo, con el estado actual de esta tecnología, las empresas deberían tener en cuenta las siguientes aportaciones a la hora de mejorar sus sistemas de IDV:

Los deepfakes van en aumento: A medida que la tecnología se vuelve más asequible, es probable que los estafadores utilicen medios sintéticos para los ataques con mayor frecuencia.

Los deepfakes son más fáciles de generar que de utilizar: Los defraudadores se enfrentan a importantes retos cuando intentan eludir los sistemas IDV con deepfakes, gracias al actual flujo de verificación.

Los deepfakes son comparables a los ataques de presentación tradicionales: Las empresas que ya son expertas en la detección de imágenes en pantalla o máscaras durante la verificación selfie están bien posicionadas para contrarrestar los ataques deepfake. Prueba de vida activa con desafíos aleatorios sigue siendo también una herramienta fiable.

Las medidas de seguridad adicionales son esenciales: Para reforzar las defensas, las organizaciones deben validar la fuente de los datos enviados por los usuarios, proteger los datos durante la transmisión e identificar los artefactos de deepfake y las incoherencias visuales.

Regula tampoco deja de avanzar en sus soluciones de IDV. Conozca más sobre las oportunidades que ofrecen las tecnologías de Regula.